KI-Token richtig nutzen: GPT, Claude und Gemini sinnvoll auswählen

Die drei großen KI-Maschinen wirken im Alltag ähnlich: Frage stellen, Antwort bekommen. Technisch arbeiten sie aber sehr unterschiedlich. Wer immer das größte Modell nimmt, verbrennt Budget. Wer zu viel alten Chatverlauf mitschleppt, macht Antworten schlechter. Sauber wird es erst, wenn Sie Token wie Arbeitsfläche behandeln: knapp, bewusst und passend zur Aufgabe.

Die kurze Regel

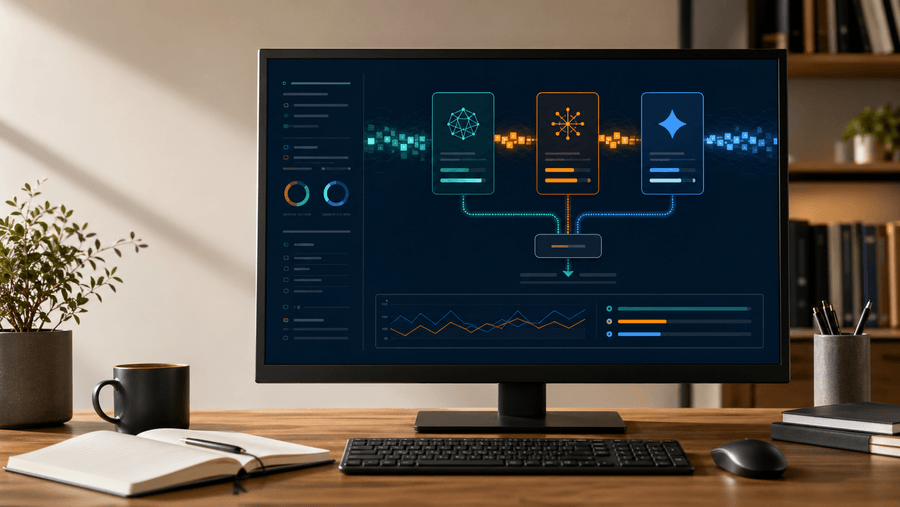

Ein gutes KI-Setup besteht nicht aus einem Lieblingsmodell, sondern aus einer einfachen Schaltlogik: kleine Aufgaben gehen an ein schnelles Modell, schwere Aufgaben an ein Denkmodell, lange Unterlagen an ein Modell mit großem Kontextfenster. Der Mensch entscheidet nicht jedes Mal neu, sondern arbeitet nach festen Klassen.

Zusammenfassen, umformulieren, E-Mail-Entwurf, Listen sortieren: schnelles Modell nehmen, kurze Eingabe, kurze Antwort.

Planung, Fehleranalyse, Code, Verträge, Recherche: stärkeres Modell nehmen und Antwortreserve einplanen.

Viele PDFs, lange Chats, ganze Ordner: erst Material sortieren, dann gezielt laden. Nicht alles in ein Fenster kippen.

Was Token in der Praxis bedeuten

Ein Token ist kein Wortzähler, sondern die interne Stückelung des Modells. Kurze Wörter können ein Token sein, lange Wörter werden aufgeteilt. Dazu kommen Systemanweisungen, Dateiinhalte, Tabellen, Bilder, Werkzeugaufrufe, vorherige Antworten und bei Denkmodellen interne Denkschritte. Genau deshalb ist eine scheinbar kurze Frage manchmal teuer: Der sichtbare Satz ist kurz, der mitgeschleppte Kontext aber riesig.

Das Kontextfenster ist die maximale Arbeitsfläche. Es enthält Eingabe, relevante Historie, Dateiinhalte, Werkzeugergebnisse, Denkarbeit und die neue Antwort. Es ist also kein Archiv. Wenn Sie einen Chat wochenlang weiterführen, wird er nicht automatisch schlauer. Er trägt auch Altlasten mit: alte Annahmen, verworfene Ideen, Zwischenstände und Fehler.

Der saubere Token-Workflow

Bevor ein Modell ausgewählt wird, sollte der Kontext vorbereitet werden. Das klingt nach Mehrarbeit, spart aber Zeit: Die Antwort wird kürzer, die Trefferquote steigt, die Kosten sinken und sensible Daten landen seltener unnötig im Modellfenster.

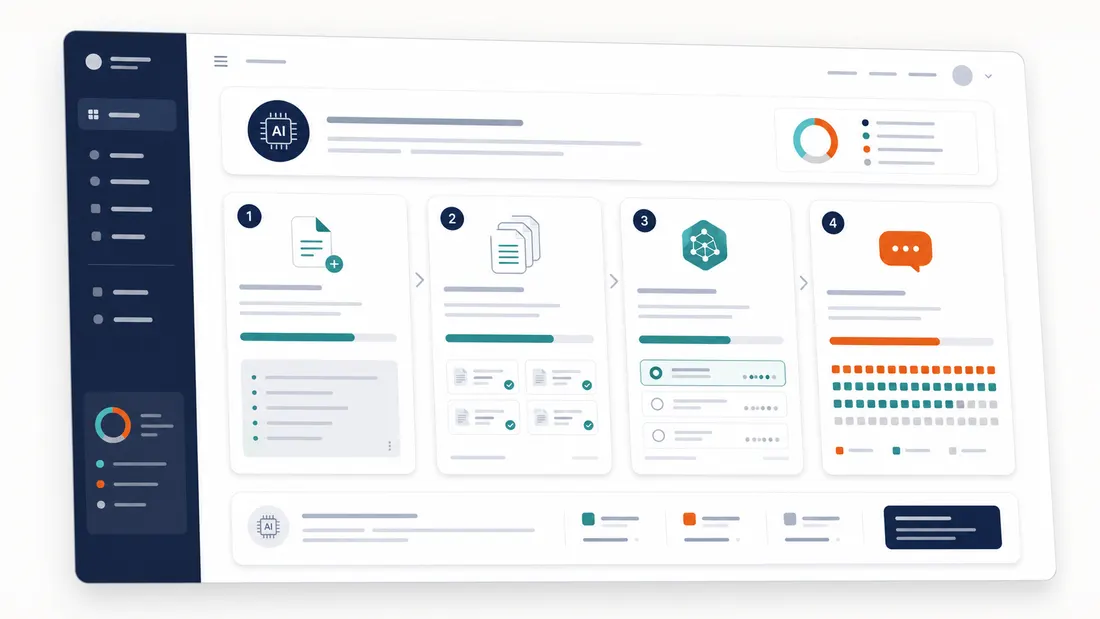

1. Ziel vor Material

Schreiben Sie zuerst auf, was am Ende herauskommen soll: Entscheidung, Liste, Prüfung, Code, Kundenmail, Tabelle. Danach laden Sie nur Material, das dieses Ziel stützt. Ein Ordner mit 30 Dateien ist kein guter Prompt. Eine sortierte Auswahl mit Fragestellung ist einer.

2. Statisches Wissen trennen

Firmenregeln, Tonalität, Produktdaten und feste Preislogik gehören in eine wiederverwendbare Grundlage. Tagesaktuelle Fälle, Kundendetails und Anhänge gehören in den konkreten Auftrag. Wenn beides vermischt wird, wächst jeder Prompt unnötig.

3. Antwortlänge begrenzen

Ein Modell schreibt gern länger, wenn es darf. Für interne Arbeit reichen oft Stichpunkte, Tabellen oder eine klare Entscheidung. Lange Prosa nur dann verlangen, wenn sie gebraucht wird. Das spart Token und macht Prüfung einfacher.

4. Denkmodelle nicht ausquetschen

Denkmodelle brauchen Platz für interne Arbeit. OpenAI weist ausdrücklich darauf hin, dass Reasoning Tokens zwar nicht sichtbar sind, aber Kontext und Budget verbrauchen. Bei komplexen Aufgaben ist es sinnvoll, große Reserve für Denken und Antwort freizuhalten, statt das Fenster bis oben zu füllen.

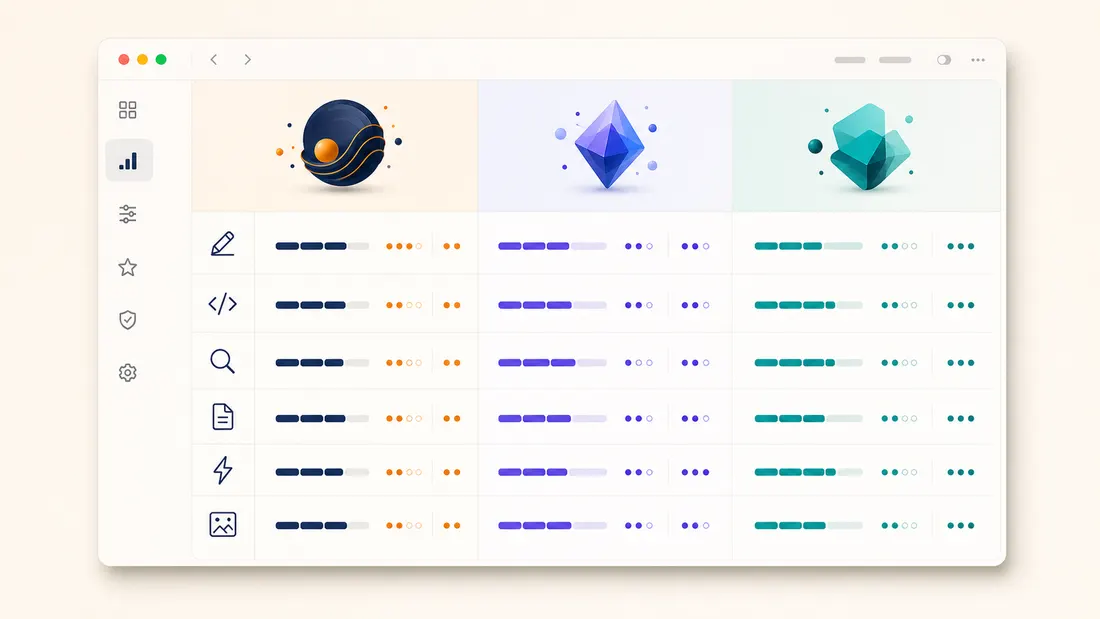

Die Top 3: welches Modell wofür?

Stand 28. April 2026 sieht die praktische Einordnung so aus: OpenAI ist stark bei allgemeiner Denkarbeit, Codex-naher Programmierung und breitem Produktzugang. Claude ist stark bei langen Dokumenten, Code-Reviews, sauberer Sprache und Agentenarbeit. Gemini ist stark bei riesigem Kontext, Multimodalität und Google-nahen Werkzeugen.

| Familie | Starke Modelle | Gute Aufgaben | Token-Hinweis |

|---|---|---|---|

| OpenAI / ChatGPT | GPT-5.5GPT-5.4Mini/Nano | Schwere Analyse, Codex-Arbeit, strukturierte Antworten, Tool-Workflows, Forschung mit vielen Zwischenschritten. | GPT-5.5 ist die Oberklasse. Für Alltag erst GPT-5.4 oder kleiner testen, dann hochschalten. |

| Claude / Anthropic | Opus 4.7Sonnet 4.6Haiku 4.5 | Code-Review, lange Texte, Unternehmensdokumente, Agenten, saubere redaktionelle Arbeit, schwierige Abwägungen. | Sonnet ist meist der beste Startpunkt. Opus für die schwierigsten Fälle, Haiku für schnelle Unteraufgaben. |

| Gemini / Google | Gemini 3.1 Pro PreviewGemini 2.5 ProGemini 2.5 Flash | Sehr lange Eingaben, PDF, Audio, Video, Suchbezug, Codeausführung, strukturierte Ausgaben und Massenverarbeitung. | 1.048.576 Eingabetoken sind stark. Trotzdem vorher schneiden, sonst bezahlt man auch irrelevantes Material. |

Aufgaben-Matrix für den Alltag

Die beste Modellwahl ist selten die teuerste. Entscheidend ist, wie hoch Risiko, Kontextmenge und Prüfaufwand sind.

| Aufgabe | Startmodell | Hochschalten, wenn | Token-Regel |

|---|---|---|---|

| E-Mail, Kundenantwort, kurze Zusammenfassung | GPT-5.4 mini, Claude Haiku 4.5, Gemini 2.5 Flash | Ton sehr wichtig ist oder rechtliche Details drinstehen. | Briefing unter 1.500 Token halten, Antwort klar begrenzen. |

| Blog, Konzept, Angebot, Strategie | Claude Sonnet 4.6 oder GPT-5.4 | Mehrere Quellen widersprechen sich oder die Entscheidung teuer ist. | Quellen trennen: Fakten, Zielgruppe, gewünschte Struktur. |

| Code, Fehleranalyse, Agentenarbeit | GPT-5.5, Claude Opus 4.7 oder Sonnet 4.6 | mehrere Dateien, Tests, Logs und Randfälle zusammenkommen. | Relevante Dateien statt ganzes Projekt. Erst Diagnose, dann Patch. |

| Lange PDFs, Protokolle, Verträge | Claude Sonnet/Opus oder Gemini 2.5/3.1 Pro | Belege, Querverweise oder exakte Fundstellen nötig sind. | Dokumente chunkweise prüfen, Ergebnis als Quellenliste speichern. |

| Viele gleichartige Datensätze | Gemini 2.5 Flash oder kleines OpenAI-Modell | Einzelprüfung mit hohem Risiko nötig wird. | Batchen, Beispiele vorgeben, Ergebnis streng strukturieren. |

Die häufigsten Fehler

Ein langer Verlauf fühlt sich bequem an, enthält aber zu viel Rauschen. Besser: Arbeitsstand zusammenfassen und neu starten.

Ohne Formatvorgabe entstehen lange Texte. Besser: Tabelle, fünf Punkte, Entscheidung mit Begründung oder konkreter Patch.

Ein Premium-Modell für kleine Aufgaben ist Verschwendung. Ein kleines Modell für riskante Arbeit erzeugt Nacharbeit.

Viele Anhänge ohne Auftrag sind kein Kontext, sondern Datenmüll. Besser: relevante Ausschnitte und klare Frage.

Wer Token nicht zählt, merkt Kosten erst auf der Rechnung. APIs liefern Nutzungsdaten, die man auswerten sollte.

KI braucht Kontext, aber nicht jedes Detail. Namen, Zugangsdaten und interne Rohdaten gehören vorher raus.

Ein brauchbarer Standard für kleine Unternehmen

Für den Alltag reicht eine einfache Drei-Stufen-Regel. Stufe eins ist das schnelle Modell für Masse. Stufe zwei ist das starke Alltagsmodell für Texte, Konzepte, Angebote und normale Codearbeit. Stufe drei ist das Spitzenmodell für Fälle, bei denen ein Fehler richtig weh tut.

Wichtig ist die Dokumentation: Welche Aufgaben laufen wohin? Welche Daten dürfen in den Prompt? Wie lang darf die Antwort werden? Wann muss ein Mensch prüfen? Ohne diese Regeln wird KI-Arbeit schnell zu Bauchgefühl. Mit Regeln entsteht ein wiederholbarer Ablauf.

Sie wollen KI nutzen, ohne jedes Mal das teuerste Modell zu nehmen?

Wir richten Modellwahl, Prompt-Vorlagen, Dokumentenablage und Datenschutzregeln so ein, dass Ihre KI-Arbeit kontrollierbar bleibt. Fernwartung und Einrichtung ab 29 € für 30 Minuten.

KI-Ablauf anfragenEmpfehlung

Starten Sie nicht mit der Frage: „Welches Modell ist das beste?“ Starten Sie mit: „Wie schwer ist diese Aufgabe, wie viel Kontext ist wirklich nötig und wie teuer wäre ein Fehler?“ Danach ist die Wahl meistens klar.

Für viele Betriebe ist Claude Sonnet oder GPT-5.4 der Alltag, Gemini Flash die Massenmaschine, Gemini Pro oder Claude/GPT-Spitzenmodelle die Langkontext- und Denkklasse. GPT-5.5 und Claude Opus 4.7 sind Werkzeuge für harte Fälle, nicht für jede Notiz.

Die Modellangaben wurden am 28. April 2026 gegen Primärquellen geprüft: